人工智能AI绘画Stable Diffusion保姆级教程 超详细小白入门指南,轻松掌握SD使用与基础软件开发

随着人工智能技术的飞速发展,AI绘画已成为创意领域的热门工具。其中,Stable Diffusion(简称SD)以其强大的图像生成能力和开源特性,深受广大用户喜爱。本教程将从零开始,手把手带你入门Stable Diffusion,涵盖安装、配置、基础操作及简单软件开发,助你轻松踏入AI绘画的世界。

一、什么是Stable Diffusion?

Stable Diffusion是一种基于扩散模型的文本生成图像AI工具,用户只需输入描述性文字(提示词),即可生成高质量、风格多样的图像。它支持本地部署,对硬件要求相对友好,适合个人学习与创作。

二、环境准备与安装步骤

- 硬件要求:

- 推荐配置:NVIDIA显卡(显存6GB以上,如RTX 2060)、16GB内存、50GB硬盘空间。

- 最低配置:显存4GB显卡,但生成速度较慢。

- 软件安装:

- 下载安装Python(版本3.10以上)和Git。

- 通过Git克隆Stable Diffusion WebUI仓库(如AUTOMATIC1111版本),运行启动脚本自动安装依赖。

- 下载预训练模型(如SD 1.5或SDXL),放入指定文件夹。

- 启动运行:

- 打开命令行,进入WebUI目录,执行启动命令。

- 在浏览器中输入本地地址(如http://127.0.0.1:7860)即可打开操作界面。

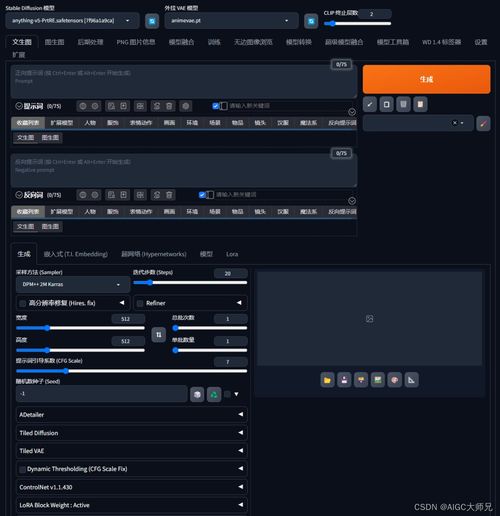

三、基础使用教程

- 界面介绍:

- 主要区域:提示词输入框(正向描述图像内容)、反向提示词框(避免不需要的元素)、参数设置区(调整图像尺寸、采样步数等)。

- 生成第一张图像:

- 在提示词框输入简单描述,如“a cute cat, cartoon style”。

- 设置基础参数:图像尺寸(512x512)、采样步数(20-30)、提示词引导系数(7-10)。

- 点击“Generate”按钮,等待生成结果。

- 优化技巧:

- 使用详细提示词:加入风格(如“oil painting”)、细节(如“detailed eyes”)以提升质量。

- 调整负面提示词:避免“blurry, deformed”等常见问题。

- 尝试不同采样器(如Euler a、DPM++ 2M)以获取多样效果。

四、进阶功能探索

- 模型与插件:

- 加载不同风格模型(如动漫、写实模型)扩展创作范围。

- 安装ControlNet插件,通过草图或姿势图控制图像结构。

- 图像修复与高清化:

- 使用Inpainting功能局部修改图像。

- 启用高清修复(Hires. fix)提升分辨率。

五、人工智能基础软件开发入门

若想基于SD进行二次开发,可参考以下步骤:

- 理解原理:学习扩散模型和Transformer架构的基础知识。

- API调用:利用SD提供的API接口,将图像生成功能集成到自己的应用中。

- 简单示例:使用Python编写脚本,自动化批量生成图像,或结合其他工具(如Flask)构建Web应用。

- 社区资源:查阅官方文档和GitHub社区,获取代码示例与技术支持。

六、常见问题与解决方案

- 显存不足:降低图像尺寸或使用优化设置(如--medvram参数)。

- 生成效果差:优化提示词,调整参数,或更换模型。

- 安装失败:检查网络环境,确保依赖包完整安装。

通过本教程,即使是零基础小白也能快速上手Stable Diffusion,享受AI绘画的乐趣。随着不断练习,你将能创作出独具特色的作品,甚至开发出自己的AI应用。持续探索,释放你的创造力吧!

如若转载,请注明出处:http://www.ympabiw.com/product/16.html

更新时间:2026-04-18 17:38:13